使用身体姿势特征和多实例学习的双人交互检测

在第二届计算机视觉与模式识别会议上的3D数据人类活动理解国际研讨会上发表,CVPR 2012

Kiwon Yun,Jean Honorio,Debaleena Chattopadhyay,Tamara L. Berg,Dimitris Samaras

Stony Brook University

抽象

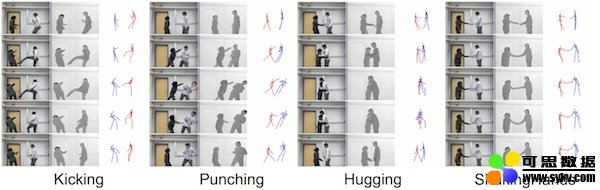

人类活动识别有可能影响从监视到人机界面到基于内容的视频检索的广泛应用。最近,便宜的深度传感器(例如,Microsoft Kinect)的快速发展为活动识别应用的实时全身人体跟踪提供了足够的准确性。在本文中,我们创建了一个复杂的人类活动数据集,描述了两个人的交互,包括同步视频,深度和动作捕捉数据。此外,在通过支持向量机(SVM)实时检测交互活动的上下文中,我们使用数据集来评估通常用于索引和检索运动捕获数据的各种功能。实验上,我们发现基于所有关节对之间距离的几何关系特征优于其他特征选择。对于整个序列分类,我们还探索了与多实例学习(MIL)相关的技术,其中序列由一袋身体姿势特征表示。我们发现当序列在感兴趣的相互作用周围时间延伸时,基于MIL的分类器优于SVM。